È un fatto noto che su Channel 4, canale TV pubblico britannico, una conduttrice virtuale abbia condotto un programma televisivo: nessuna carne, nessun respiro, nessuna voce reale. Solo codice per AI. Sembrava umana e il pubblico british ha trovato la cosa interesting, con quel noioso vezzo inglese per prendere tempo e farsene un’idea o semplicemente per non dire “è uno schifo”… Il mio vecchio amico Richard, bilingue di padre inglese ma nato e cresciuto a Roma, però spergiura che interesting venga usato allo stesso modo del romanesco “e ‘sti cazzi?” per significare più o meno “nun me frega gnente, ma so’ contento pe’ tté ”: letteralmente.

Quell’algoritmo di Channel 4 è un preludio, un test con cui si sposta un confine etico senza chiedere permesso. Perché il punto non è la tecnologia, ma ciò che in sé rappresenta. Quando una rete pubblica decide che al posto di una persona può parlare un avatar, non sta innovando: sta ridefinendo il significato di “presenza umana”, e qualche brivido sulla schiena c’è.

La realtà senza corpo

La televisione – più di ogni altro media – vive di immagine e di aspettative; perciò quelli di Channel 4 hanno tentato la perfezione, il capolavoro, prendendo l’ovale di X, i capelli di Y, gli occhi di Z, la voce di Y e le movenze di J… Per cui quando sullo schermo è apparsa quella figura e l’hanno chiamata “conduttrice”, si è compiuto un salto simbolico: “non c’è più bisogno di un corpo reale”. Perché?

Per evitare problemi umani. Il conduttore umano può sbagliare, emozionarsi, tacere. Può disobbedire al regista, saltare una scaletta, finanche dire ciò che ha realmente in testa, un avatar no. Un avatar non fa palpitare né regista né produttore, non salta, non sbaglia, non prova empatia. È perfetto proprio perché voluto così: ma in un mondo che confonde la perfezione con la verità, questo diventa un maledetto problema di libertà professionale… e stendiamo un pietoso velo sulla libertà personale.

Lo stesso criterio algoritmico che ha rifatto la conduttrice artificiale di Channel 4 è anche quello che, pochi giorni fa, ha generato il più grande scandalo europeo di pornografia deepfake: un sito che mostrava migliaia di immagini di donne – esistenti e ignare – i cui volti erano stati rifatti su corpi nudi generati da intelligenza artificiale. Corpi inesistenti, ma convincenti. Un esercito di finzioni erotiche costruite con un algoritmo per l’umiliazione del genere femminile: l’unica desolante (e banale) conclusione è che neanche la pornografia è più quella di una volta.

Ecco la perfetta simmetria del nostro tempo: da un lato, il volto artificiale che parla al mondo in nome della verità; dall’altro, il volto reale che viene usato per una menzogna pornografica. In entrambi i casi, la donna diventa immagine simbolo e vittima della tecnologia digitale.

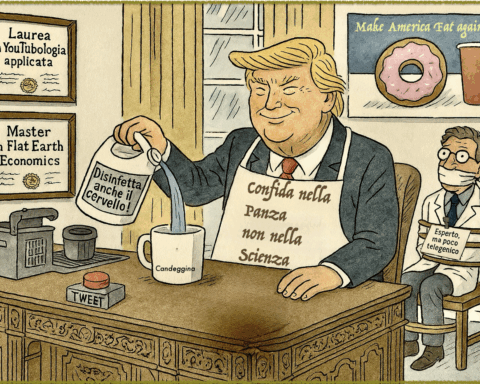

Il potere dietro il codice è neutrale? Manco per niente

…ma c’è un mito che dobbiamo smontare subito: che la tecnologia sia neutrale. È una scusante che mi lascia perplesso, perché dietro ogni algoritmo c’è un’ideologia, un interesse economico, una gerarchia di poteri per fare od ottenere qualcosa. La tecnologia non decide da sola chi deve essere rappresentato e chi può essere cancellato. Lo decidono i tecnici, i media, gli investitori, i politici che da secoli usano l’immagine come strumento di dominio.

Quando un’emittente pubblica sostituisce una conduttrice in carne e ossa con un avatar, il messaggio è chiaro: la presenza umana è superflua, l’emozione è un orpello. Quando un sito porno crea corpi falsi con volti reali, il messaggio è lo stesso: la volontà dell’individuo è un dettaglio. La linea che unisce questi due estremi è sottile ma precisa: la volontà di utilizzare l’immagine altrui senza pagarne il prezzo etico.

Sociologia dell’inganno

Dal punto di vista sociologico, siamo in una fase di de-materializzazione del reale. Il volto può essere simulato, la voce clonata, la personalità ricostruita; questa smaterializzazione ci allontana dal contatto, dalla responsabilità, dalla partecipazione, dall’empatia… è ciò che accade in guerra quando con droni digitali si uccidono persone lontane 1000 Km: ci si dematerializza, ma il risultato non è virtuale è concretamente reale, come il lavoro di una conduttrice virtuale su menti vere. Uguale.

Nel linguaggio della sociologia digitale, si parla di disintermediazione affettiva: l’emozione non nasce più dall’incontro tra due persone, ma dal riconoscimento di un modello. Non parliamo con l’altro, ma con la sua versione statistica-digitale. E quando l’altro scompare, non ce ne accorgiamo nemmeno. Così, mentre contempliamo la conduttrice perfetta, non vediamo che la sua perfezione coincide con la nostra irrilevanza.

Non serve più sbagliare, non serve più vivere. Basta essere “renderizzati”.

Il prezzo della perfezione

In realtà che l’AI abbia sostituito una conduttrice televisiva, non è una novità clamorosa. Il settore delle fotomodelle e della fotografia pubblicitaria è in grande crisi, in tanti manifesti e pagine pubblicitarie sia i personaggi che le scenografie sono fatti in AI, e da un po’ la si usa anche per le voci, basta campionare una bella voce e l’avatar parlerà con la sua inflessione; e poi un avatar non dorme, non protesta, non invecchia, non fa ferie, è il paradiso travestito da progresso del capitalismo.

Il corpo umano costa, ha diritti, limiti, desideri, sindacati, malattie. Un avatar è proprietà esclusiva di chi lo genera: è una cosa impalpabile, e come tutte le cose può essere usata, replicata, copiata, anche sfrattata senza spese e motivazioni… Quindi, la domanda non è più: “Cosa si può fare con l’AI?”, ma piuttosto: “Chi decide cosa si può fare ancora con l’umano?”

L’AI non ci sta rubando l’anima: gliela stiamo consegnando noi gratis in cambio di efficienza e intrattenimento. Abbiamo scambiato la verità con la comodità, la libertà con la qualità dell’immagine. Ma arriverà il momento in cui guarderemo uno schermo e non sapremo più se a parlarci sia un politico, un conduttore o un algoritmo programmato per farci credere a tutto (e in USA già sta avvenendo).

E allora capiremo che il prezzo della perfezione è la scomparsa del reale, del tangibile. La prima conduttrice artificiale e il primo scandalo di pornografia AI sono due facce della stessa medaglia: il potere di trasformare il corpo umano in interfaccia di una volontà terza.

Il cortocircuito della fiducia: autenticità come atto politico?

Viviamo immersi in immagini. Fino a un paio di anni fa credevamo che “vedere” fosse sinonimo di “credere”. Oggi, sui social in particolare, non possiamo più distinguere se ciò che vediamo è reale o generato. E questo produce un effetto devastante: una crisi della fiducia collettiva, che fatalmente mette in crisi anche la Democrazia, che rischia di implodere in un rumore di simulazioni perfette.

Ma c’è speranza… ogni eccesso di artificio genera una reazione di realtà; cresce il bisogno di voci vere, sul web impazzano video girati male ma autentici, di storie con rughe e balbettii, e tornando alla pornografia i dati dicono che quella casereccia sia la più seguita… e allora è probabile che l’autenticità tornerà a essere un valore di mercato, ma anche un gesto politico.

Noi giornalisti -prima di tutti gli altri- dovremo ripartire dall’esperienza vissuta e riappropriarci del diritto di sbagliare, di fare fatica. L’umanità non è un difetto da correggere, è una prova di esistenza, e un volto reale, con tutte le sue imperfezioni, resta l’unica forma di resistenza possibile in un mondo che ci vuole impeccabili e sostituibili.

Il futuro è scritto nella nostra capacità di dire NO: NO al falso perfetto. NO alla verità prefabbricata. NO all’idea che “tanto è lo stesso”.

Perché non è lo stesso, l’imperfezione dà valenza all’umanità e anche alla verità.